En 1617 John Napier da a conocer el ábaco rabdológico cuya función era calcular productos y cocientes. Estaba compuesto por una tabla numerada en un lateral y varias varillas de marfil.

Ábaco neperiano (Museo Arqueológico Nacional español)

.

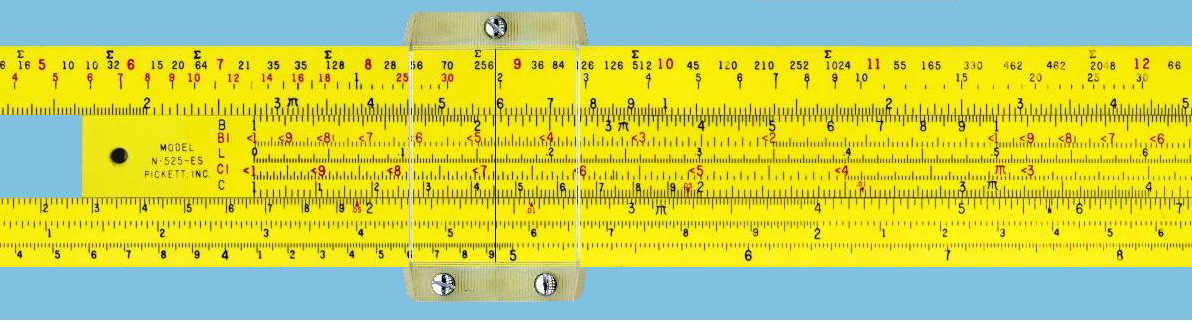

Pocos años más tarde, entre 1620 y 1630, aparece la regla de cálculo, invento que se atribuye a William Oughtred. La regla de cálculo permitía realizar operaciones aritméticas mediante escalas basadas en los logaritmos: se emplean líneas superpuestas de números que se desplazan, permitiendo realizar los cálculos.

En 1623 el astrónomo alemán Wilhelm Schickard inventa la primera máquina de cálculo, a la que llamó reloj calculador y que fue ideada para ser usada por su amigo astrónomo Johannes Kepler, a quien escribió unas cartas en las que adjuntaba diversos bocetos del invento y detallaba su funcionamiento (usaba discos dentados), lo que sirvió para hacer una reconstrucción a escala que está expuesta en el Museo de la Ciencia de Munich.

.

El modelo original fue destruido en un incendio. Es considerada como la primera calculadora mecánica.

El físico y matemático francés Blaise Pascal a la edad de 19 años desarrolló, en 1642, un calculador mecánico, primeramente llamado Máquina aritmética, y después Pascalina, para realizar sumas y restas. Usaba un sistema de ruedas dentadas similar al que ideó Schickard. La base de las operaciones consistía en contar los dientes de un engranaje, al igual que un cuenta kilómetros.

Uno de los primeros lenguajes de programación informática lleva su nombre: el lenguaje Pascal (1970).

Gottfried Wilhelm Leibniz (1646-1716), filósofo, matemático, físico, jurista y político alemán, tiene también un lugar importante dentro de la historia de la informática. Mención especial merece la creación del cálculo infinitesimal, descubrió el cálculo diferencial. Fue el precursor de la lógica matemática, proponiendo un sistema binario para la realización de cálculos.Leibniz también inventó una máquina de cálculo que se llamó Calculadora Universal, capaz de realizar sumas, diferencias, multiplicaciones, divisiones e, incluso, raíces cuadradas. Su elemento característico era un tambor cilíndrico con nueve dientes de longitud variable, llamado rueda escalonada o rueda de Leibniz, que se encuentra en prácticamente todas las calculadoras mecánicas posteriores, incluso en algunas del siglo XX.

Estas no eran máquinas automáticas ya que requerían la intervención humana durante el proceso.

A comienzos del siglo XIX, el francés Joseph-Marie Jacquard inventa un telar mecánico cuyos diseños se reproducían gracias a una serie de tarjetas perforadas, las cuales permitían repetir el diseño del dibujo en la tela siempre que se desease. Las tarjetas perforadas transmitían a la tejedora las instrucciones necesarias para su funcionamiento.

El matemático e ingeniero británico Charles Babbage es considerado el auténtico padre de los ordenadores. Debido a los numerosos errores que se producían en el cálculo de tablas matemáticas, tuvo la idea de crear una máquina que ejecutara ese trabajo, eliminando el error humano y facilitando la tarea de realizar operaciones repetitivas. En 1822 presentó su proyecto para el desarrollo de la 'máquina diferencial' en la Royal Astronomical Society. Resolvía polinomios de segundo grado mediante un método numérico diferencial. Era capaz de realizar cualquier cálculo y de almacenar programas.

Babbage contó con la colaboración de la matemática Ada Augusta Byron (1815-1852), hija de Lord Byron, que fascinada por el trabajo del inventor, participó en el patrocinio y la promoción de la máquina analítica.

Ada escribió diversos programas para resolver ecuaciones trascendentes e integrales definidas. De este modo se considera a Ada Byron como la primera programadora de ordenadores del mundo. En su honor se llamó Ada al lenguaje de programación desarrollado en 1979 a instancias del Departamento de Defensa de los Estados Unidos, que buscaba estandarizar los numerosos programas que existían.

Charles Babbage murió sin lograr terminar de construir su gran invento, pero sus ideas y diseños sentarían las bases para el desarrollo de los ordenadores modernos.

George Boole, matemático y filósofo británico, hizo público en 1854 un estudio sobre las leyes del pensamiento en las que se basan las teorías matemáticas de la lógica y la probabilidad, aplicando símbolos a operaciones lógicas. Surge así el álgebra de la lógica o álgebra de Boole, que en el siglo XX sería aplicado en la construcción de ordenadores y circuitos.

Herman Hollerith ingeniero neoyorquino de origen alemán, consiguió por vez primera automatizar el procesamiento de grandes cantidades de información con la ayuda de un aparato de propia creación: la máquina censadora o tabuladora

En 1896 Hollerith fundó su propia compañía, Tabulating Machine Company, que en 1911 se fusionó con otras dos empresas, formando la Computing Tabulating Recording Company (CTR), ésta a su vez pasa a manos de Thomas Watson en 1914 y diez años más tarde, en 1924, tomaría el nombre de International Business Machines (IBM).

La aparición de la tecnología eléctrica permite la incorporación de relés, interruptores binarios con 2 posiciones: encendido-apagado. Se recupera el sistema de numeración binario, ya usado por Leibniz. Importante es la aportación de Boole que reduce la lógica (operaciones matemáticas) a combinaciones de Verdadero-Falso.

En agosto de 1936 Alan Mathison Turing publicó un artículo sobre el funcionamiento de calculadores binarios. La Máquina de Turing era una máquina teórica que sería capaz de transformar con precisión operaciones elementales, previamente definidas, en símbolos. Prácticamente al mismo tiempo, en Estados Unidos, Alonzo Church dió a conocer el 'Lambda Calculus', un trabajo equivalente, naciendo así la Tesis de Church-Turing.

Por ello,Turing y Church, son considerados padres de la Ciencia de la Computación y la Inteligencia Artificial.

Basándose en estos fundamentos, el ingeniero Konrad Zuse construyó en 1938 la Z1, un prototipo de computadora electromecánica de sistema binario que podía ser programada y usaba relés eléctricos para automatizar los procesos, leyendo las instrucciones de una cinta perforada.

No llegó a funcionar correctamente debido a la imperfección de las piezas mecánicas.

En 1941 creó la Z3, disponía de una memoria de 64 palabras, procesador, unidad de lectura y unidad de control que decodificaba la instrucción leída y transfería los datos.

En 1950 realiza la primera venta de un ordenador a una compañía suiza, sería el modelo Z4.

John Vincent Atanasoff estadounidense de origen búlgaro, doctor en Física teórica, es considerado el inventor del ordenador digital electrónico. Atanasoff concibió la idea 'en una taberna de Iowa', durante el invierno de 1937. Estableció los cuatro principios básicos en los que se fundamentaría su invento: el uso de electricidad y componentes electrónicos, un sistema binario, condensadores como elementos de memoria y un sistema lógico para el cómputo ( y no la enumeración, como ocurría con las máquinas análogas).

La construcción se realizó entre 1937 y 1942, y Atanasoff contó con la ayuda de Clifford Edward Benning, un alumno de ingeniería eléctrica. En diciembre de 1939 habían terminado un prototipo que funcionaba correctamente y al que llamarían ABC (Antanasoff Berry Computer).

En 1940 Antanasoff asiste a una conferencia del Dr. John William Mauchly y le muestra su máquina.

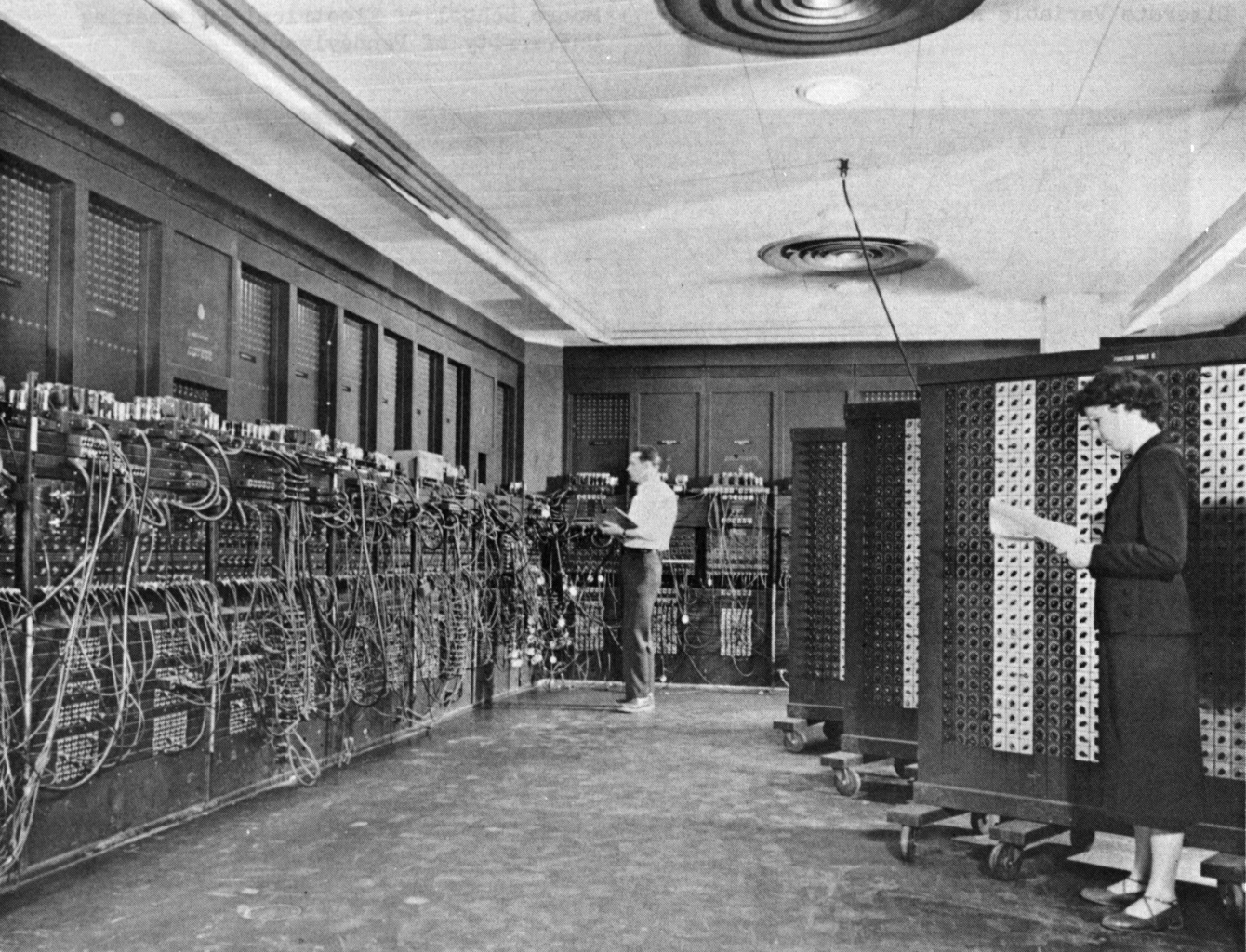

Mauchly copia ideas de la ABC para diseñar junto con John Presper Eckert la ENIAC (Electronic Numerical Integrator And Computer), considerada la primera computadora digital electrónica del mundo, hasta que en 1967 un litigio entre Honeywell y Sperry Rand Corporation (que había adquirido la patente sobre la ENIAC), provocó que un juez concluyera en 1973 que la patente de ENIAC no era válida.

En 1938 se publicó la tesis del ingeniero y matemático estadounidense Claude Elwood Shannon, sobre la Teoría matemática de la Comunicación, en la que demostró cómo el álgebra de Boole se podía utilizar en el análisis y la síntesis de la conmutación y de los circuitos digitales y cómo la combinación de circuitos podía representar operaciones aritméticas y lógicas complejas, relacionando así lógica y electrónica. Las aportaciones de Shannon serían fundamentales también en el desarrollo de la criptografía y los sistemas de compresión de datos.

En febrero de 1944, el ingeniero estadounidense Howard Hathaway Aiken, financiado por IBM, termina la construcción del ordenador electromecánico MARK I, basándose en los diseños de la máquina analítica de Charles Babbage. Tenía unas dimensiones gigantescas: medía unos 15,5 metros de largo, unos 2,40 metros de alto y unos 60 centímetros de ancho, su peso era de unas cinco toneladas y en su interior se repartía un cableado de unos 800 kilómetros de longitud con casi 3 millones de conexiones. Estaba compuesta por unas 750.000 piezas, y cerca de 1500 interruptores. Hacía uso del sistema decimal en lugar del binario, y contenía 72 registros mecánicos, cada uno de los cuales podía almacenar 23 dígitos decimales más un dígito para el signo.

El 15 de febrero de 1946 se hace una presentación pública en la Universidad de Pennsylvania de ENIAC.

Fue el primer computador digital electrónico. Pesaba 32 toneladas y medía 2,40 metros de ancho por 30 de largo. Estaba compuesto por 17.460 válvulas, 7.200 diodos de cristal, 1.500 relés, 70.000 resistencias, 10.000 condensadores y 5 millones de soldaduras, produciendo tal calor que la temperatura de la sala en que se encontraba llegaba a los 50ºC. Disponía de capacidad para resolver en un segundo 5.000 sumas y 360 multiplicaciones, aunque para reprogramarla era preciso cambiar de posición las conexiones de los cables, lo que requería un trabajo muy laborioso.

En 1952 se concluyó la construcción del EDVAC (Electronic Discrete Variable Automatic Computer). Diseñada también por Mauchly y Eckert, a quienes se unió el matemático húngaro John von Neumann. Esta computadora contaba por primera vez con capacidad de almacenamiento de memoria para los programas, lo que evitaba el tedioso trabajo de reconexión que era necesario en la máquina ENIAC. La memoria consistía en líneas de mercurio dentro de un tubo de vidrio al vacío, donde un impulso electrónico podía ir y venir en 2 posiciones, para almacenar los ceros y unos, empleando así números binarios. Constaba de 4.000 válvulas y 10.000 diodos de cristal, con una autonomía de hasta 8 horas.

El transistor (Transfer Resistor) es inventado por los Laboratorios Bell Telephone en 1947. Acabará sustituyendo a los tubos de vacío o válvulas, debido a la gran diferencia de sus prestaciones: tamaño minúsculo, menor coste y menor consumo eléctrico, generando así también menos calor. La vida útil del transistor es prácticamente ilimitada, mientras que las válvulas debían ser reemplazadas con mucha frecuencia. Las primeras computadoras construidas completamente a base de transistores fueron introducidas por las compañías NCR (NCR 304,1957) y RCA (RCA 501,1958). Sin embargo, IBM creó los modelos más populares en la década de los 60. El primer modelo de IBM que empleaba transistores fue el IBM 7090, creado a finales de 1958.

Tiene lugar también la ampliación de las memorias internas, la generalización del concepto de arquitectura modificable y el uso de periféricos de gran masa de memoria como los tambores y discos magnéticos.

Aparecen los lenguajes ensambladores que traducen las instrucciones del código máquina:

- FORTRAN (Formula Translator), lenguaje empleado en aplicaciones científicas y desarrollado entre 1954 y 1957 por la compañía IBM.

- LISP (List Processing) creado en 1958 por John McCarthy en el Instituto Tecnológico de Massachusetts.

- COBOL (Common Business Oriented Language) informática de gestión empresarial.

- ALGOL (Algorithmic Language). Usado en las universidades.

En 1959, el ingeniero estadounidense Jack St. Claire Kilby inventó el circuito integrado monolítico cuando trabajaba para Texas Instruments. El invento original era un dispositivo creado con un monocristal de germanio que integraba seis transistores en una misma base semiconductora. Esto permitió por un lado abaratar costos y por el otro aumentar la capacidad de procesamiento reduciendo el tamaño físico de las máquinas.

En 1974, la empresa estadounidense Intel Corporation presentó el modelo de microprocesador 8080. Contenía 4.500 transistores y podía manejar 64k de memoria RAM. El 8080 fue el cerebro del primer ordenador personal (PC), el Altair 8800, fabricado por la compañía MITS (Micro Instrumentation Telemetry Systems). El primer modelo no contaba con monitor ni teclado, tan sólo con luces LED y pequeñas palancas o switches para facilitar la programación. La información era almacenada en cassettes de grabadoras y era visualizada en aparatos de televisión.

El primer lenguaje de programación para la máquina fue el Altair BASIC, escrito por William Henry Gates y Paul Allen, quienes después fundarían Microsoft. El Sistema Operativo que utilizaba el Altair 8800 era el CP/M (Control Program for Microcomputers), escrito por Gary Kildall.

En 1976 Steve Wozniak (entonces ingeniero en Hewlett-Packard) y Steve Jobs (que trabajaba en Atari) fabrican en el garaje de su casa la microcomputadora Apple I. Steven Jobs convenció a Wozniak para continuar la fabricación para la venta al público y en abril de 1976 nació la empresa Apple Computers. El Apple I se construía manualmente y no llegó a ser vendido de forma masiva.

En 1981 IBM lanza al mercado su primer IBM-PC. En esta época destaca el desarrollo de los sistemas operativos, que buscan una integración entre el usuario y el ordenador, a través de la utilización de gráficos.

_________________________________